高粱是酿造白酒的主要谷物之一,高粱的品种和品质直接影响酒体的品质和风格[1-2]。不同品种高粱的不完善粒和杂质的变异程度不一样,是评判其质量的关键指标[3]。不完善粒是指受客观因素影响,具有破损、生芽、虫蚀、生霉、热损、病斑等缺陷特征,但仍具有使用价值的颗粒[4]。目前不完善粒检测仍然主要依靠人工识别,这种劳动强度大、效率低、主观性强、重复性差的传统检测方式无法适应现代粮食检测行业快速、准确和客观的要求。

为克服传统人工检测的弊端,研究者们发展出了基于声学检测[5-6]、基于化学方法检测[7-8]、基于高光谱成像技术[9-11]和基于机器视觉[12-14]的检测方法。声学检测速度快,不受主观因素影响,但易受噪声影响,检测精度较低。化学检测具有直观、快速的特点,但重复性差,易对环境造成污染,无法做到无损检测。高光谱成像技术具备外部和内部的全方面无损检测特性,但受限于高昂的检测设备和复杂的图像数据,无法有效大规模应用。 早期机器视觉识别方法由于受限于计算设备、高质量数据、视觉理论框架,需依赖复杂繁琐的人工特征提取,以提高算法的识别性能[15-16]。深度学习是一种机器学习技术,其核心是人工神经网络,能够通过训练大量数据进行决策。基于深度学习的无损检测技术具有速度快、精度高、重复性好及成本低等优势。于锦龙等[17]提出了一种识别小麦不完善粒的ML-EfficientNet模型,结合轻量通道和空间注意力机制(lightweight channel and spatialattention,LCSA),解决了小麦不完善粒识别模型复杂度高的难题。张庆辉等[18]提出了多尺度并行卷积神经网络MSPCNeXt,通过对大卷积核进行分解,有效地提高了小麦不完善粒的识别率。目前,基于深度学习的不完善粒检测仪器主要有GK9800型粮食不完善粒分析仪、Cgrain Value型谷物不完善粒分析仪和P600型谷物品质分析仪[19]。

本研究提出了一种基于深度学习的高粱不完善粒检测方法,利用GK9800型粮食不完善粒分析仪采集图像,采用数据增强的预处理技术优化图像后,以ConvNeXt-V2为基础模型网络架构,加入通道注意力机制(channel attention mechanism,CAM)和空间注意力机制(spatial attention module,SAM)模块改进模型,并考察改进后模型对高粱不完善粒的检测效果。以期实现高粱不完善粒的正确分类,为白酒酿造企业在高粱原料质量管控方面提供技术支持。

1 材料与方法

1.1 试验材料

糯小高粱(产地贵州)、杂交粳高粱(产地吉林)、12份高粱样品(验证用,每份50 g):贵州某酱香型白酒厂。

1.2 仪器与设备

GK9800型粮食不完善粒分析仪[20](该设备是一款用于检测大米、小麦、大豆、玉米、高粱等粮种的不完善粒的自动化设备,由硬件系统和软件部分构成,逐粒下料和360°拍摄方式避免了噪声干扰和关键特征漏采,可对被检测物的各项检测指标进行较为客观、准确、高效的检测评估,检测数据便于保存,有效提高了粮食检测识别精度):迩言(上海)科技有限公司;DJ-A1000电子天平:福州华志科学仪器有限公司。

1.3 方法

1.3.1 图像采集

试验前从所选高粱样品中由专业质检员用电子天平称取50 g样品,分别挑选出完善粒及虫蚀粒、生芽粒、破损粒、生霉粒、热损伤粒和病斑粒等不完善粒,分别将不完善粒倒入GK9800型粮食不完善粒分析仪的放料口,系统通过控制振动下料模块输送试样到被采集区域,光电传感器检测到样品后触发相机进行360°拍照,每粒高粱形成不同角度的4张图像,共采集糯小高粱63 569粒和杂交粳高梁57 753粒,共得到图像485 288张,其中糯小高粱完善粒、虫蚀粒、生芽粒、破损粒、生霉粒、热损伤粒、病斑粒图像分别为103444张、24 924张、10 056张、94 748张、16 840张、1 704张、2 560张,杂交粳高梁分别为93 824张、21 684张、9 548张、86 712张、15 460张、1 516张、2 268张。

1.3.2 图像数据增强

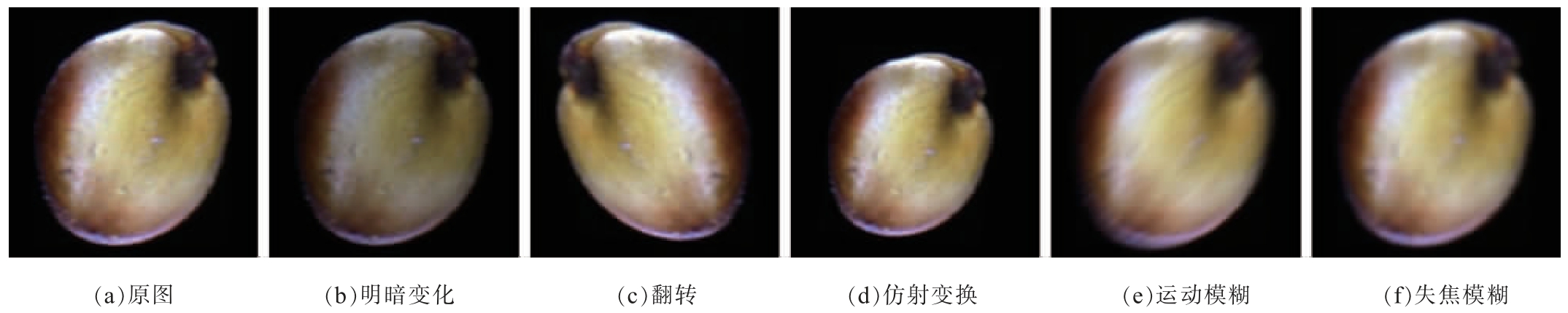

考虑到部分类型高粱样本实际采集中样本较少(如热损伤粒、病斑粒等),造成各类型数据严重不平衡,实际采集环境复杂多变,为增加模型适应性,通过明暗变化、翻转、仿射变换、运动模糊、失焦模糊等方法进行数据增强,平衡数据集,增加数据多样性(图1)。 数据增强后共得到原始图像和增强图像共712 372张,划分为完善粒、虫蚀粒、生芽粒、破损粒、生霉粒、热损伤粒和病斑粒7个类别。 其中,完善粒209 188张、虫蚀粒86 120张、生芽粒68 344张、破损粒199 620张、生霉粒67 860张、热损伤粒46 844张和病斑粒34 396张,按7∶2∶1随机划分为训练集、验证集和测试集。

图1 数据增强处理后的高粱图像

Fig. 1 Sorghum images after data augmentation processing

1.3.3 ConvNeXt-V2模型

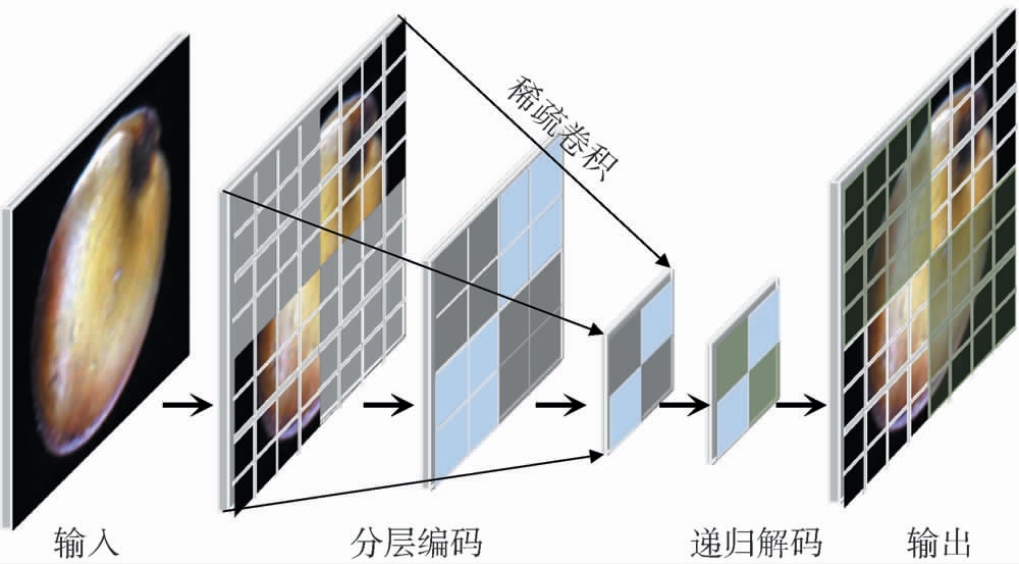

ConvNeXt-V2[21]作为卷积神经网络(convolution neural network,CNN)结构的优化版本,借鉴了Vision Transformer (ViT)的设计理念,采用掩蔽自动编码器(masked autoencoder,MAE)架构,将稀疏卷积纳入全卷积掩码自动编码器(fully convolutional masked autoencoder,FCMA)框架。 在预训练过程中,ConvNeXt-V2随机屏蔽输入图像的一部分,利用稀疏卷积提取未屏蔽的部分输入特征,经分层编码得到高层语义特征,采用递归解码重建原始图像(图2)。这种方法实现了掩码自动编码器的自监督预训练,有效的提高了模型的泛化能力。此外,动态可分离卷积和全局响应归一化提高了局部特征提取能力,降低了计算成本,使模型的训练更加稳定。 基于以上优点,本研究以ConvNeXt-V2为主干网络应用于高粱不完善粒分类任务。

图2 全卷积掩码自动编码器

Fig. 2 Fully convolutional masked autoencoder

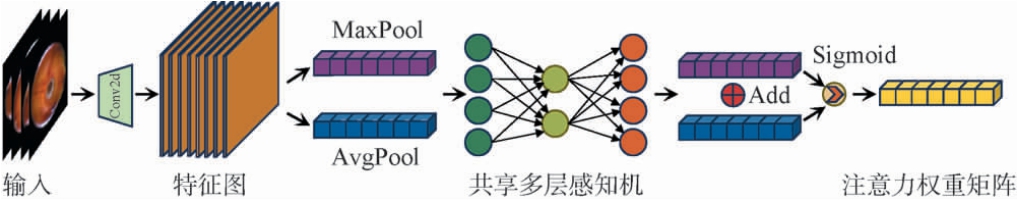

1.3.4 通道注意力网络结构

实际采集过程中,高粱不完善特征可能出现在任意视角中的某一张或多张图像中,有效提取不完善特征对模型的性能至关重要。 在卷积神经网络中,不同通道的特征对最终任务的贡献程度往往不同。为了关注重要的不完善特征通道,抑制不重要通道,神经网络需要学习不同通道的重要程度。因此,引入通道注意力机制(CAM)加强提取不完善特征,输入过程中,不同视角的高粱图像在通道维度上拼接形成多通道输入图像。通过卷积后得到高层特征图,分别在空间维度上进行全局最大池化(MaxPool)和全局平均池化(AvgPool)生成1×1×C的特征图(C为通道数)。生成的1×1×C的特征图分别送入一个共享的多层感知机(MLP)中学习,得到同样维度的两个特征图。对MLP生成的特征图相加经过Sigmoid激活函数映射处理,最终得到注意力权重矩阵(图3)。注意力权重矩阵Fc计算公式如下:

图3 通道注意力网络结构

Fig. 3 Channel attention network architecture

式中:c为通道数, 和

和 分别为全局最大池化和全局平均池化特征。

分别为全局最大池化和全局平均池化特征。

1.3.5 空间注意力网络结构

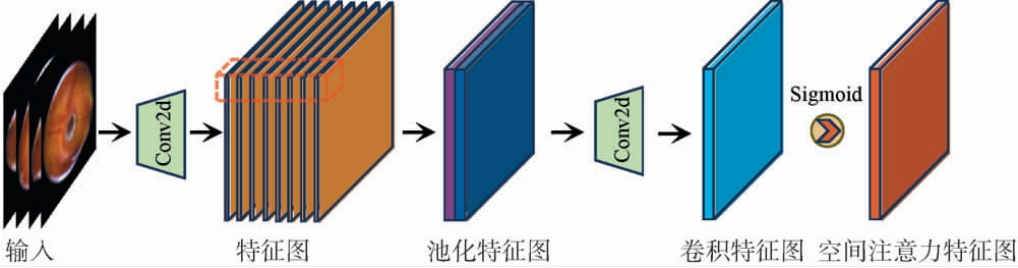

通道注意力机制(CAM)能有效捕捉不同视角的潜在不完善特征,解决了视角定位的难题,然而,即使是同一视角的图片,不完善特征出现在图片中的不同位置及不同类别却呈现相似特征的图片会影响模型的识别精度。

空间注意力机制(SAM)通过对特征图空间内部的关系来产生空间注意力特征图,能有效聚焦于特征图上的不完善特征信息。 空间注意力首先对输入的H×W×C的特征图F进行通道维度的全局最大池化和全局平均池化,得到两个H×W×1的特征图。将得到的两个特征图进行通道维度上拼接,经过卷积得到尺寸为H×W×1的特征图,接着通过Sigmoid激活函数映射,得到最终的空间注意力权重矩阵。整体流程图见图4。空间注意力计算公式如下:

图4 空间注意力网络结构

Fig. 4 Spatial attention network architecture

式中:s 表示空间维度, 和

和 分别为通道维度全局最大池化和全局平均池化。

分别为通道维度全局最大池化和全局平均池化。

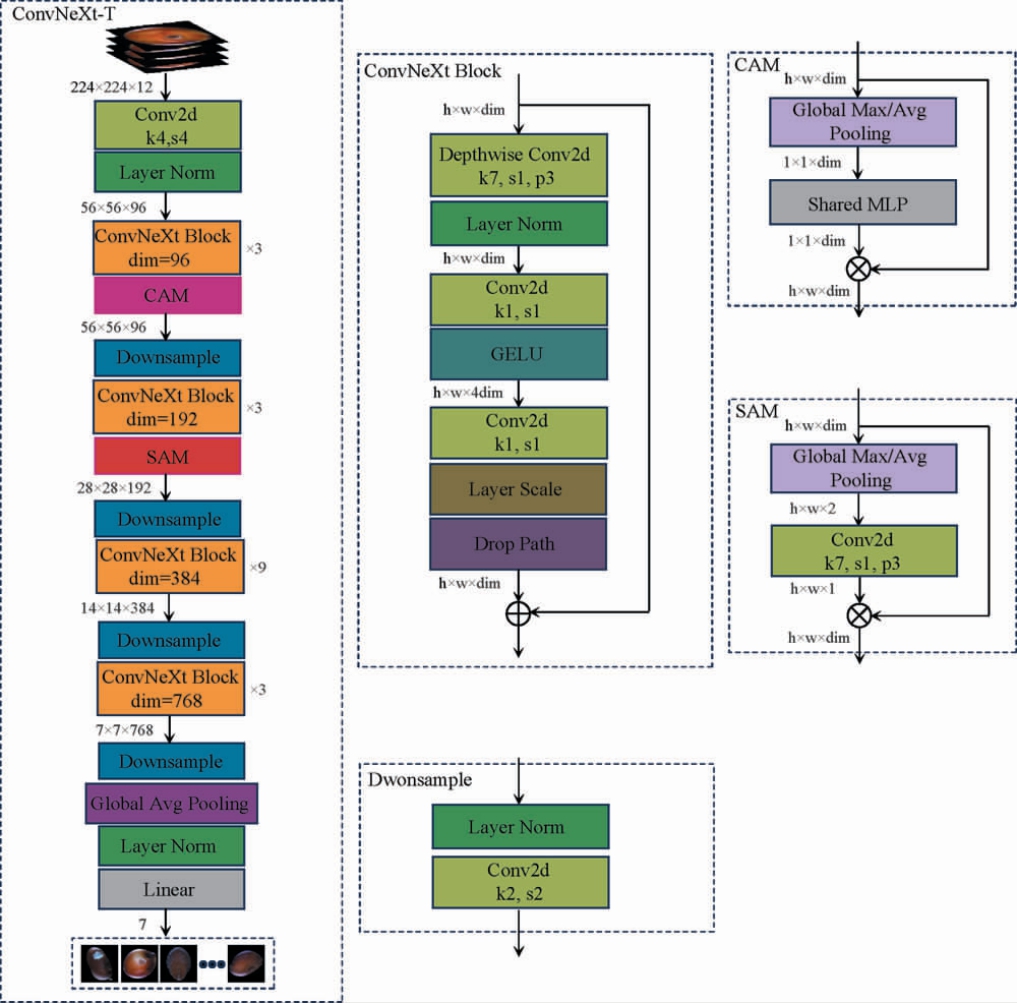

1.3.6 基于ConvNeXt-V2改进的网络结构

由于不同视角不完善特征的潜在性和不完善特征空间分布的不确定性,本研究以ConvNeXt-V2中ConvNeXt-T为基本网络架构,引入CAM和SAM结构,整体网络结构见图5。 由图5可知,ConvNeXt-T由多个阶段层与基础模块堆叠而成,图像输入网络后经过卷积核大小为4×4的卷积层进行下采样,使用Layer Norm进行归一化。使用4个堆叠次数比为3∶3∶9∶3的ConvNeXt Block,前2个Block中分别引入CAM和SAM提取关键特征,后3个Block中均使用Downsample降采样,保持前后维度一致性。 特征输出使用全局平均池化和Layer Norm处理,最后使用全连接实现分类,本文分类数量设置分类数为7类。

图5 改进的ConvNeXt-V2网络结构

Fig. 5 Improved ConvNeXt-V2 network architecture

1.3.7 评价指标

为评价不完善粒识别模型的分类性能,本文采用准确率(accuracy,A)、F1值来评价网络模型分类结果质量,使用模型权重参数(M)评价模型计算复杂度(M值越大,推理和训练时计算量越大)。 在分类问题中实例可分为正类(positive)或负类(negative),实际分类结果有四种情况,即真正类(true positive,TP),假负类(false negative,FN),假正类(false negative,FP),真负类(true negative,TN)。

准确率是在所有样本中预测正确的概率,计算公式如下:

精确率(A)是预测中实际为正样本在所有预测为正样本的概率,计算公式如下:

召回率是预测中实际为正样本在所有实际正样本的概率,计算公式如下:

F1值是综合考虑了精确率(P)和召回率(R),用于衡量分类器性能的评价指标,F1值介于0~1之间,在处理不平衡类别的情况下作用显著,计算公式如下:

2 结果与分析

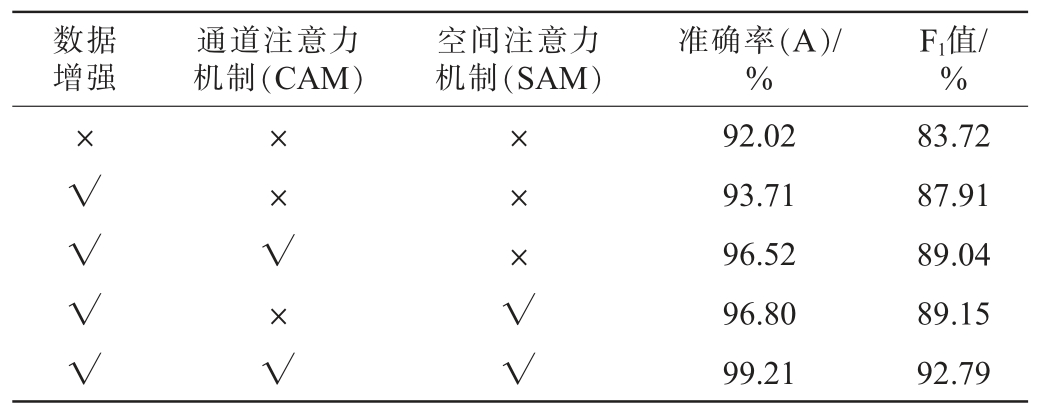

2.1 数据增强、CAM和SAM对模型性能的影响

所有模型统一使用Pytorch框架在NVIDIA 4090 GPU 24G显存上训练,训练过程中batchsize设置为32,模型输入大小为224×224×12,保持模型训练收敛到最优为止。数据增强、通道注意力机制和空间注意力机制对模型性能的影响见表1。数据增强处理后,模型分类的准确率和F1值分别提升1.69%和4.19%;加入通道注意力机制(CAM)时,模型的分类准确率和F1值分别提升2.81%和1.13%;加入空间注意力机制(SAM)时,模型的分类准确率和F1值分别提升3.09%和1.24%;同时加入CAM和SAM时,模型分类准确率和F1值分别提升5.5%和4.88%。 结果表明,同时加入CAM和SAM能明显提升模型性能。

表1 数据增强、通道注意力机制和空间注意力机制对模型性能的影响

Table 1 Effect of data augmentation, channel attention mechanism,and spatial attention mechanism on model performance

注:“√”表示使用该技术或引入该结构;”×”表示不使用该技术或引入该结构。

数据增强通道注意力机制(CAM)空间注意力机制(SAM)准确率(A)/%F1值/%×√√√√××√×√×××√√92.02 93.71 96.52 96.80 99.21 83.72 87.91 89.04 89.15 92.79

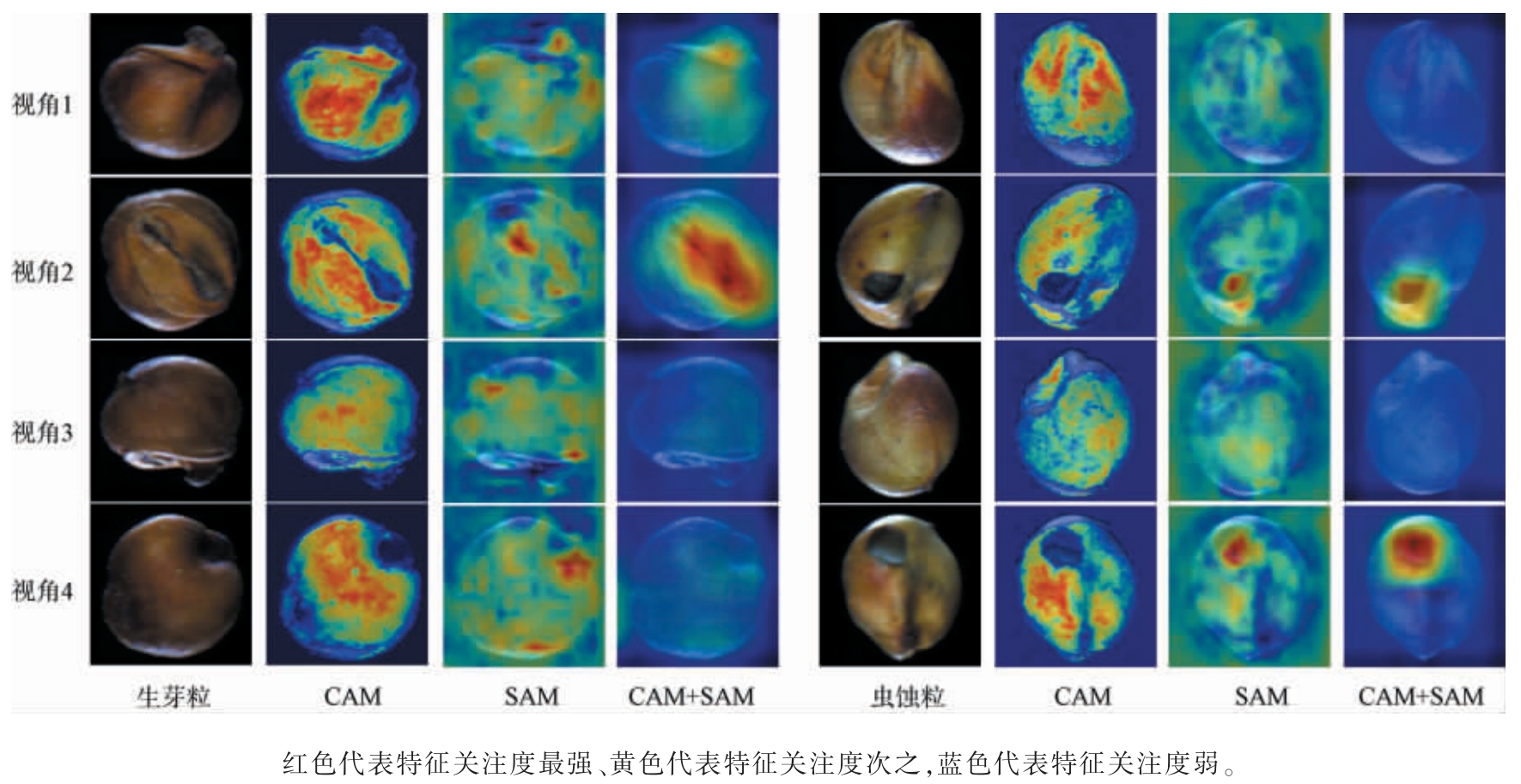

2.2 特征可视化

为了更直观的验证提出模型的有效性,本研究采用梯度加权类激活映射(gradient-weightedclassactivationmapping,Grad-CAM)可视化技术对部分高粱不完善粒图像(图6中生芽粒、虫蚀粒)分别引入通道注意力机制(CAM)、空间注意力机制(SAM)、通道注意力机制(CAM)+空间注意力机制(SAM)进行可视化分析,可视化结果见图6。

图6 高粱不完善粒图像特征可视化

Fig. 6 Visualization of unsound sorghum kernel image feature

由图6可知,CAM对不同通道(视角)的整体性关注性较强,然而对生芽粒和虫蚀粒局部的不完善特征无法有效的聚焦;SAM能聚焦于通道内部的不完善特征部分(生芽粒视角2中部分生芽特征呈现强关注度红色,虫蚀粒视角2、4中部分虫孔特征呈现强关注度红色),但其他通道的干扰无法避免;同时加入CAM和SAM则能准确的关注到通道内局部的不完善特征,避免通道间的竞争干扰,从而提升模型对于解决高粱不完善特征的潜在性和相似性问题(生芽粒和虫蚀粒中仅生芽和虫孔特征呈现强关注度红色,其他部分呈现弱关注度蓝色),有效的提升模型的性能。

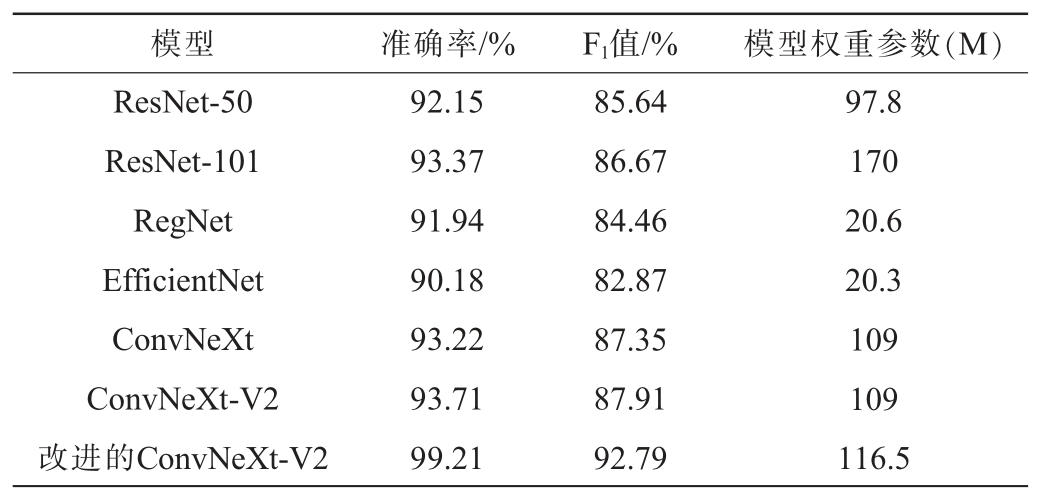

2.3 不同模型分类性能对比结果

为准确评估提出本研究建立模型的性能,与网络模型ResNet-50[22],ResNet-101[22],RegNet[23],EfficientNet[24],Conv-NeXt[25],ConvNeXt-V2[21]等主要模型进行对比,所有模型均基于pytorch框架实现,使用数据增强技术进行预处理,所有模型参数设置均要保证模型最优性能。不同模型在测试集上的分类性能对比结果见表2。

表2 不同模型分类性能对比结果

Table 2 Comparison results of classification performances of different models

模型准确率/%F1值/%模型权重参数(M)ResNet-50 ResNet-101 RegNet EfficientNet ConvNeXt ConvNeXt-V2改进的ConvNeXt-V2 92.15 93.37 91.94 90.18 93.22 93.71 99.21 85.64 86.67 84.46 82.87 87.35 87.91 92.79 97.8 170 20.6 20.3 109 109 116.5

由表2可知,本研究建立的改进ConvNeXt-V2模型准确率、F1值分别达99.21%、92.79%,其他模型分类的准确率范围为90.18%~93.71%,F1值范围为82.87%~87.91%。 结合模型权重参数(M)分析发现,改进的ConvNeXt-V2模型权重参数(M)与ConvNeXt、ConvNeXt-V2模型无明显差异,但准确率和F1值均较高,表明改进ConvNeXt-V2模型能得到显著提升,该模型能够准确识别高粱不完善粒。

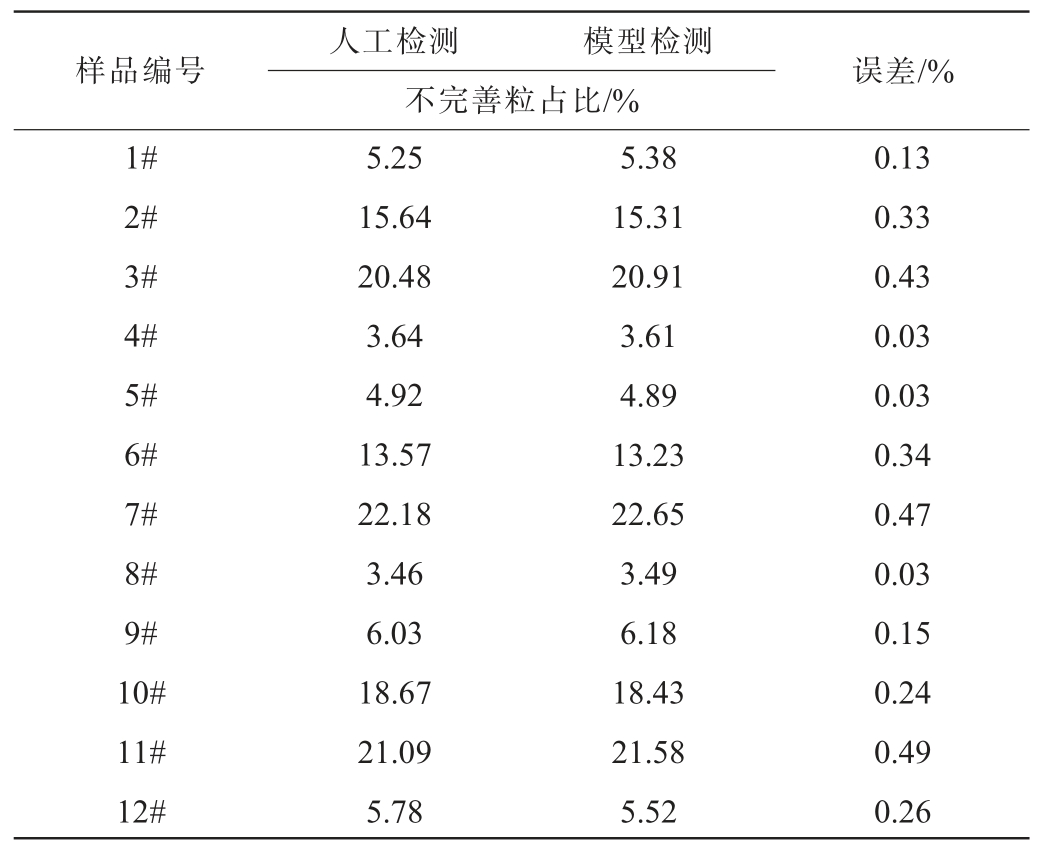

2.4 高粱不完善粒检测对比结果

为进一步评估所提方法的有效性,本研究随机选取12个批次的高粱样品,分别对人工和改进的ConvNeXt-V2模型对不完善粒的检测结果进行比较,结果见表3。由表3可知,采用人工检测与改进的模型检测的不完善粒占比差异不大,误差范围为0.03%~0.49%,所有样品的平均误差为0.24%。这表明与人工检测方法相比,改进的ConvNeXt-V2模型检测效果无明显差异,具有较高的可靠性和准确性,满足高粱不完善粒质量快速检测的实际应用需求。

表3 人工及改进的ConvNeXt-V2模型检测对比结果

Table 3 Comparison results of manual and improved ConvNeXt-V2 model detection results

人工检测不完善粒占比/%模型检测样品编号误差/%1#2#3#4#5#6#7#8#9#10#11#12#5.25 15.64 20.48 3.64 4.92 13.57 22.18 3.46 6.03 18.67 21.09 5.78 5.38 15.31 20.91 3.61 4.89 13.23 22.65 3.49 6.18 18.43 21.58 5.52 0.13 0.33 0.43 0.03 0.03 0.34 0.47 0.03 0.15 0.24 0.49 0.26

3 结论

本研究通过构建自建高粱图像数据集,并结合数据增强、ConvNeXt-V2基础模型以及通道注意力机制(CAM)和空间注意力机制(SAM)模块优化特征提取能力。 结果表明,同时加入CAM和SAM模块后,分类准确率和F1值分别提升了5.5%和4.88%,识别准确率高达99.21%,优于其他对比模型。 不完善粒图像特征可视化显示,改进后的模型能够准确识别不完善特征,提升模型的可解释性。 与人工检测方法相比,改进的ConvNeXt-V2模型对高粱不完善粒的检测效果无明显差异,进一步验证了模型的稳定性和重复性,平均误差为0.24%,有效减少了人为主观因素的影响。本研究可为酿酒行业提供一种高效、精准且可靠的高粱质量检测方案,有助于提高检测一致性,减少人为误差,并推动智能检测技术在粮食质量控制中的应用。未来工作将聚焦于模型轻量化设计以提升检测速度,并探索方法在不同品种高粱及其他粮食作物不完善粒检测中的适用性,以满足更广泛的工业需求。

[1] 吕佳慧.白酒酿酒和制曲原料中结合态风味物质的研究[D] .无锡:江南大学,2017.

[2] 高进,蔡立旺,王永慧,等.甜高粱新品种(系)综合评价与聚类分析[J] .江苏农业科学,2017,45(20):93-97.

[3] 魏铭,何宏魁,刘卓,等.我国主要种植高粱品种营养品质评价研究[J] .中国粮油学报,2025,40(3):79-86.

[4] 国家市场监督管理总局,中国国家标准化管理委员会.GB/T 5494—2019粮油检验粮食、油料的杂质、不完善粒检验[S] . 北京:中国标准出版社,2019.

[5] PEARSON T C,CETIN A E,TEWFIK A H,et al.Feasibility of impactacoustic emissions for detection of damaged wheat kernels[J] .Digit Signal Process,2007,17(3):617-633.

[6] 李杰,吴桂芳,德雪红,等.农产品品质无损检测方法的研究进展[J] .粮食与饲料工业,2024(4):70-76.

[7] 孙宝胜.小麦中呕吐毒素含量与不完善粒关系研究[J] .现代面粉工业,2018,32(5):28-31.

[8] JIAWEI L, MINLI Y, MUYI H, et al. Rapid and selective detection of AFB1 by direct mass spectrometry using immunoaffinity paper substrate[J] .Microchem J,2024,190:109439.

[9] 李彭,李艳艳,何学明,等. 高光谱成像技术在粮食品质检测中的应用[J] .粮食储藏,2024,53(4):1-12,109-110.

[10] HE H J,SUN D W.Hyperspectral imaging technology for rapid detection of various microbial contaminants in agricultural and food products[J] .Trends Food Sci Tech,2015,46(1):99-109.

[11] WANG C, LIU B, LIU L, et al. A review of deep learning used in the hyperspectral image analysis for agriculture[J] .Artif Intell Rev,2021,54(7):5205-5253.

[12] LIN W,SHU L,ZHONG W,et al.Online classification of soybean seeds based on deep learning[J] .Eng Appl Artif Intel,2023,123:106434.

[13] SHEN R,ZHEN T,LI Z.Segmentation of unsound wheat kernels based on improved mask RCNN[J] .Sensors,2023,23(7):3379.

[14] 李冰杰,王超群,赵小萌,等.基于机器视觉的小麦不完善粒快速分析仪适用性评价[J] .中国粮油学报,2024,39(10):174-179.

[15] LIAO K,PAULSEN M,REID J,et al.Corn kernel shape identification by machine vision using a neural network classifier[J] .Transact ASAE,1992,36(6):1949-1953.

[16] GUNASEKARAN S, COOPER T, BERLAGE A. Evaluating quality factors of corn and soybeans using a computer vision system[J] .Transact ASAE,1988,31(4):1264-1271.

[17] 于锦龙,于俊伟,张自豪,等. 基于改进EfficientNet的轻量化小麦不完善粒识别模型[J] .中国粮油学报,2025,40(2):192-202.

[18] 张庆辉,王晶平,吕鹏涛,等. 基于多尺度并行卷积的小麦不完善粒检测研究[J] .河南工业大学学报(自然科学版),2025,46(1):96-104.

[19] 王晨光,禹金霞,盖倩. 三种小麦不完善粒自动检测仪对比试验研究[J] .粮油仓储科技通讯,2024,40(4):34-36,39.

[20] 李小红,褚毅宏,毛育志,等. 酿酒高粱不完善粒检测仪检测模型的研究与检验[J] .粮油食品科技,2023,31(1):129-134.

[21] WOO S, DEBNATH S, HU R, et al. Convnext v2:Co-designing and scaling convnets with masked autoencoders[C] //Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.2023:16133-16142.

[22] HE K,ZHANG X,REN S,et al.Deep residual learning for image recognition[C] //Proceedings of the IEEE conference on computer vision and pattern recognition.2016:770-778.

[23] RADOSAVOVIC I, KOSARAJU R P, GIRSHICK R, et al. Designing network design spaces[C] //Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.2020:10428-10436.

[24] TAN M,LE Q.Efficientnet:Rethinking model scaling for convolutional neural networks[C] //International conference on machine learning.PMLR,2019:6105-6114.

[25] LIU Z,MAO H,WU C Y,et al.A convnet for the 2020s[C] //Proceedings of the IEEE/CVF conference on computer vision and pattern recognition.2022:11976-11986.